Lista de tópicos em questão

-

19. Como é produzida e escrita com a qual interagimos nos chatbots? Podemos dizer que a composição da escrita se baseia na compreensão? Se sim, que tipo de compreensão? — Uma Interação com o ChatGPT

-

18. Inteligência Artificial e Humanidades: informação, conhecimento e aprendizagem

17. Modelos lógicos e a retórica

-

16. Virtuoso, vicioso?

-

15. Nas nossas costas, enquanto escolhermos não olhar.

-

14. Num dos fulcros do desastre

-

13. Laços e conexões: o tempo?

-

12. Especialização e ignorância, conhecimento e neo-obscurantismo: que fazer?

-

11. Camada visível e camada invisível: coisas em que pouco ou nada pensamos!

-

10. O que é “crítica”?

-

9. Que opções estamos a fazer quando nomeamos e aceitamos a designação «inteligência artificial»?

-

8. Desmaterialização ou rematerialização?

-

7. O que se perde no processo de quantificação?

-

6. Intelecto e inteligência são o mesmo?

-

5. O que escreve o ChatGPT sobre a discussão em torno da AI?

-

4. O que podem ser os Digital Studies?

-

3. Para onde vais, racionalidade?

-

2. Deixar os dados e os números falarem?

-

1. Um novo modelo civilizacional?

18. Inteligência Artificial e Humanidades: informação, conhecimento e aprendizagem

Rui Alexandre Grácio (CLLC) | 16 de julho 2025 | Comunicação apresentada na Research Summit 2025 Universidade de Aveiro

O avanço exponencial da Inteligência Artificial (IA), em particular dos sistemas generativos de linguagem e de automação dos processos discursivos e hermenêuticos, representa um dos fenómenos mais marcantes do presente. Contudo, a sua aplicação no campo do saber e da aprendizagem, e em especial no domínio das Humanidades, exige uma análise crítica que ultrapasse as dimensões técnicas ou utilitárias e se inscreva num horizonte epistemológico, ético e existencial mais vasto.

Dito de outro modo, as humanidades, orientadas historicamente para a reflexão crítica, a problematização, a criação e negociação de sentidos, a interpretação e a argumentação, não podem ignorar as transformações digitais em curso. Contudo, tão pouco podem acolhêlas de forma acrítica, sob pena de comprometer as bases epistemológicas e formativas que as caracterizam. É exigida uma literacia digital crítica.

A este respeito, importa distinguir três conceitos fundamentais: informação, conhecimento e aprendizagem.

A IA opera de forma altamente eficiente no domínio da informação, estruturando dados dispersos e respondendo a perguntas objetivas, com base numa lógica algorítmica de cálculo e inferência estatística. Mas o conhecimento não se reduz à mera acumulação ou organização de dados. Conhecer implica integrar, interpretar, atribuir sentido e problematizar — processos que exigem reflexão crítica, mediação humana e enraizamento linguístico, histórico e cultural.

Por outro lado, o processo de aprendizagem, nas Humanidades, não se limita a adquirir competências técnicas, mas envolve a metabolização do saber, ou seja um processo individual de apropriação e de maturação, feito através do confronto com a complexidade e do cultivo da capacidade crítica, aberta e interrogativa.

Uma das vias de acesso a essa lente crítica pode ser a distinção entre saber que e saber de, ou então, entre perguntas e questões: as primeiras solicitam respostas concretas, que esgotem a pergunta, e, em muitos casos, a IA pode ser, a nível informativo do saber que, uma ferramenta eficaz. Já as questões, no sentido profundo do termo, dizem respeito a assuntos, a problemáticas abertas — sobre o sentido, os valores, o agir humano, a justiça, a linguagem e a finitude — que exigem problematização contínua e não se esgotam em respostas automáticas, tornadas operacionais por agenciamento fragmentado de informações. Ora, do ponto de vista das humanidades, é importante contrariar a tendência que leva a que o saber de se reduza a um saber que e que o interrogar degenere rapidamente em mero perguntar, a um mero jogo de perguntas e respostas.

O mundo da IA é, estruturalmente, o mundo do cálculo. Os sistemas algorítmicos operam a partir da identificação de padrões estatísticos em grandes volumes de dados, projetando probabilidades formais e antecipações de comportamento. Esta racionalidade é essencialmente calculadora, orientada para a previsibilidade, a eficiência e o controlo técnico do futuro. O seu ideal é a busca do desenvolvimento de métodos formalmente limitados, mas estatisticamente robustos, para navegar a incerteza com confiabilidade operacional.

Este modelo de pensamento alimenta uma lógica de antecipação manipuladora, cuja promessa reside na segurança e na prevenção. Esta promessa exerce um fascínio profundo, pois responde ao desejo humano de eliminar a incerteza, controlar o imprevisível e proteger-se da vulnerabilidade.

Contudo, nas Humanidades e na experiência prática da vida humana, o "provável" assume outra natureza, pois nelas se lida, não com o provável calculável matematicamente, mas com um provável refratário ao cálculo. Trata-se de uma noção que remonta à tradição aristotélica e que está diretamente relacionado com a phronesis — a prudência ou sabedoria prática —, que opera em contextos de incerteza real, irrepetível, e em que os limites da analiticidade humana são constitutivos.

Neste quadro, o agir e o pensar não se reduzem à inferência estatística ou ao cálculo de probabilidades, mas implicam discernimento, juízo ético, diálogo e abertura à ambiguidade e à dimensão vaga e aproximada de muitas noções. É que todas essas vertentes são requeridas e apropriadas para lidar com as situações da vida onde sabemos coisas, mas não sabemos tudo e onde persistem muitas zonas cinzentas.

É por isso que me parece que a racionalidade algorítmica carrega perigos: ao tentar neutralizar a contingência e a imprevisibilidade próprias da existência humana, debilita a capacidade humana de lidar, com coragem, autonomia e carácter, com o inesperado, com os limites e com a finitude.

A vida humana, na sua enigmaticidade, não se reduz a padrões estatísticos nem se esgota na gestão técnica do risco. Envolve abertura à surpresa, ao tecnicamente indecidível e à incerteza radical dimensões que exigem formação ética, coragem existencial, maturação interior e refinamento do carácter.

Outro perigo reside em tomar o discurso da IA — coerente, estruturado e estatisticamente provável — como portador de uma verdade objetiva e certa, sem necessidade de verificação. Este fenómeno reforça uma visão funcionalista do saber e do agir, onde o valor do conhecimento se mede apenas pela sua utilidade, previsibilidade ou capacidade de gerar soluções técnicas.

Paralelamente, a dependência crescente da IA induz uma sensação de poder excessivo, baseado na ilusão de controlo sobre o saber e sobre o futuro. Mas esse poder é ambíguo: ao delegar à tecnologia o trabalho de estruturação conceptual e de antecipação, o sujeito vê-se reduzido a um apêndice funcional dos sistemas algorítmicos, fragilizando a sua autonomia intelectual e a sua capacidade de lidar, com coragem e sentido crítico, com o que escapa ao controlo técnico.

Este processo é agravado pela tendência para o individualismo e para o consumo solitário do saber, tendência que fragiliza os laços comunitários e as práticas convivenciais e dialógicas que são nucleares nas Humanidades.

Ao privilegiar respostas rápidas, personalizadas e tecnologicamente mediadas, perde-se o espaço do debate, da partilha de interpretações e da construção coletiva de sentido, essenciais à aprendizagem e à cidadania.

Por outro lado, ainda, é preciso recordar que as grandes infraestruturas tecnológicas estão concentradas nas mãos de corporações transnacionais, orientadas pelas lógicas do capitalismo global e do consumismo. A promessa de eficiência e de segurança, associada à IA, esconde um colonialismo de dados e uma estratégia de mercantilização do saber, que coloca em risco a autonomia, a diversidade e o espírito crítico que estruturam as Humanidades.

Pergunto-me porque que é que são silenciadas as interrogações e os debates acerca dos contratos "Termos e Condições" que cegamente e de uma forma normalizada assinamos para aceder às tecnologias digitais.

Face a este cenário, é imperativo que as Humanidades cultivem uma resistência consciente à tecnificação do pensamento, à proliferação do impensar e à hegemonia do cálculo. Grande parte das inquietações que levam à necessidade de regulação da IA contemplam tanto esse sentido de resistência, quanto a preocupação do não agravamento de desigualdades sociais quanto, ainda, as apreensões ecológicas e energéticas que estas tecnologias colocam.

Concluo, pois, dizendo que a tecnologia, incluindo a IA, pode ser uma aliada na organização da informação, na exploração de fontes e na implementação de novas metodologias de investigação. Ela não substitui, todavia, o percurso formativo que implica a construção de carácter, o enfrentamento da incerteza e o desenvolvimento do pensamento crítico. Não deixar esfumar esta dimensão é hoje uma tarefa urgente, sob pena de vermos o humano subordinado ao cálculo, o saber crescentemente convertido em mercadoria e a aprendizagem reduzida a mera simulação de respostas automatizadas.

Rui Alexandre Grácio

17. Modelos lógicos e a retórica

“O mundo real é mais complexo do que aquilo que os modelos lógicos simples conseguem representar. Precisamos de lidar com a ambiguidade e o conflito entre regras. Precisamos de assimilar o contexto e de efectuar um juízo de quando as regras poderão ser razoavelmente infringidas, e um sistema especialista baseado na lógica não consegue fazer isso” (Lawrence, N. (2025). Humano, demasiado humano — o que nos torna únicos na era da inteligencia artificial. Gradiva, p. 92). Aquilo de que Lawrence nos fala remete para a necessidade da retórica, tal como ela foi exemplarmente definida por Aristóteles, a saber, como «a capacidade de descobrir o que é adequado a cada caso com o fim de persuadir» (Aristóteles, 1998: 1355b), definição que deve ser lida conjuntamente com a afirmação de que «é também evidente que ela [a retórica] é útil e que a sua função não é persuadir mas discernir os meios de persuasão mais pertinentes para cada caso» (idem). E, no entanto, é este exercício desafiante de aplicação ao caso concreto que parece tendermos hoje a entregar às (o plural é importante) inteligências artificiais quando lhes associamos a chamada aprendizagem automática.

Rui Alexandre Grácio

16. Virtuoso, vicioso?

Numa interessante obra intitulada Weapons of Math Destruction: how big data increases inequality and threatens democracy, a sua autora, Cathy O’Neil, refere que os modelos informático-algorítmicos “definem a sua própria realidade e usam-na para justificar os seus resultados” (p. 13). Algo de semelhante, ou seja, o ilusionismo de efeito de espelho, foi também referido por Charles Willard, um teórico da argumentação, quando sobre a abordagem das argumentações através de esquemas e diagramas afirmou: "os teóricos querem definir uma coisa e, portanto, descrevem-na diagramaticamente; depois atribuem à natureza da coisa as propriedades do diagrama” (Willard, C. A. (1992). On the Utility of Descriptive Diagrams for the Analysis and Criticism of Arguments. In Benoit, W. L., Hample, D., Benpoit, P. J. (Eds) (1992), Readings on argumentation. Foris Publications, Berlin/New York, pp. 239-277.)

E a pergunta que se coloca é a seguinte: será que grande parte do funcionamento de algo não repousa na nossa adesão a esse funcionamento? Talvez seja na atenção aos jogos de espelhos com que tendemos a iludir a pesistência e a reincidência dos problemas, arranjando-lhe e impondo-lhe soluções úteis, que reside um dos aspetos decisivos para escolher entre a virtude, ou o vício, com que abordamos as propostas tecno-solucionistas.

Afinal, lembra-nos ainda Cathy O’Neil, “os modelos são opiniões embebidas em matemática” (p. 24) e a ideia de chegarmos a um conhecimento sem enviesamentos pode ser apenas uma forma de “os camuflamos com tecnologia” (p. 26)

Rui Alexandre Grácio

15. Nas nossas costas, enquanto escolhermos não olhar | Margarida Davim

https://visao.pt/opiniao/tudo-e-politica/2025-01-24-nas-nossas-costas-enquanto-escolhermos-nao-olhar/

Rui Alexandre Grácio

14. Num dos fulcros do desastre

“O presidente Jair Bolsonaro há pouco tomou uma decisão completamente equivocada, ao meu ver, vetando o direito (previsto na Lei Geral de Proteção de Dados Pessoais) de um usuário solicitar a revisão humana de uma decisão automatizada. Entende-se, com esse veto, que a racionalidade algorítmica (que, claro, não é atributo do algoritmo em si, mas de uma rede de corporações, protocolos, códigos, interesses econômicos etc.) deve ser impermeável à revisão e ao questionamento de grande parte da sociedade, o que é desastroso.”

Tecnopolítica, racionalidade algorítmica e mundo como laboratório: entrevista com Fernanda Bruno (02 Novembro 2019) em https://www.ihu.unisinos.br/categorias/594012-tecnopolitica-racionalidade-algoritmica-e-mundo-como-laboratorio-entrevista-com-fernanda-bruno

Outra informação sobre o assunto:

https://feed.itsrio.org/a-polêmica-da-revisão-humana-sobre-decisões-automatizadas-a81592886345

Sugestão de um filme para refletir:

Rui Alexandre Grácio

13. Laços e conexões: o tempo?

É curiosa a expressão que se refere à geração “que sempre viveu conectada”, como se antes da internet não houvesse conexões. Mas, na realidade, o que se deu foi uma metamorfose no tipo de conexões que o meio (que nunca é apenas uma ferramenta neutra), simultaneamente, proporciona e condiciona (empurrando para uma dependência inapelável relativamente ao tipo de mediação sobre a qual estamos longe de poder exercer controlo, até porque, se pode ser de fácil utilização, é de muito obscura compreensão em termos de processo).

Z. Bauman distingue, por exemplo, entre laços e conexões, os primeiros requerendo tempo e maturação e os segundos apenas um botão de ligar e de desligar. Os primeiros implicam uma vinculação humana entre humanos e o tempo da sua construção; os segundos surgem como um meio pragmático de operacionalizar contactos no regime da instantaneidade.

O tempo (e por isso também o humano) é aquilo que, em última instância, a via digital quer colocar sobre seu controlo. Com que consequências?

O unidimensional volta a atacar sob a retórica do infinito sem finito, das possibilidades sem limites, do positivo sem negativo. E, no entanto, é a figura da morte que paira no jubiloso anúncio que proclama a elisão do tempo no slogan “Tudo, aqui e agora”.

Rui Alexandre Grácio

12. Especialização e ignorância, conhecimento e neo-obscurantismo: que fazer?

Dois excertos convidam-nos a refletir sobre a questão enunciada no título: um de Augusto Abelaira e outro de Edgar Morin. São um interessante ponto de partida para a formulação da questão e para o debate. Aqui ficam:

"Para um leigo é melindroso falar de medidas de austeridade governamentais. Tão melindroso como discutir as grandes teorias da astronomia moderna. O leigo apanha, se é que apanha, as conclusões, mas falta-lhe a capacidade de vigiar minuciosamente os raciocínios que a elas conduzem. E a prudência, em matéria económica como astronómica, estará em ouvir silenciosamente os especialistas. O inconveniente da prudência: a cumprir tal regra teremos de nos entregar ao silêncio quase total. Na Idade Média ou no Renascimento ainda era possível abarcar todo o saber. Mas hoje? Conheci certa vez o mais famoso especialistas mundial de rãs, que sinceramente me confessou nada saber de rãs, mas de uma determinada espécie de rãs. Recusava-se, portanto, a falar da rã. Com mais razão ainda recusava-se a falar de gramática ou de futebol. Ao que chegámos: quando aparentemente o Homo Sapiens conquistou após tantos anos de luta, a liberdade, ei-lo condenado ao silêncio. Na melhor das hipóteses, se for estudioso e supremamente inteligente, falará de uma determinada espécie de rãs.”

Abelaira, A., in «O Jornal» de 19/08/83.

«Não devemos eliminar a hipótese de um neo-obscurantismo generalizado, produzido pelo mesmo movimento das especializações, no qual o próprio especialista se torna ignorante de tudo aquilo que não respeite à sua disciplina, no qual o não especialista renuncia previamente a toda a possibilidade de reflectir sobre o mundo, a vida, a sociedade, deixando este cuidado aos cientistas, os quais não têm nem tempo nem meios conceptuais para isso. Situação paradoxal onde o desenvolvimento do conhecimento instaura a resignação à ignorância e onde o desenvolvimento da ciência é, ao mesmo tempo, o da inconsciência.”

Morin, E. (1994). Ciência com Consciência. Publicações Europa-América, p. 26.

Rui Alexandre Grácio

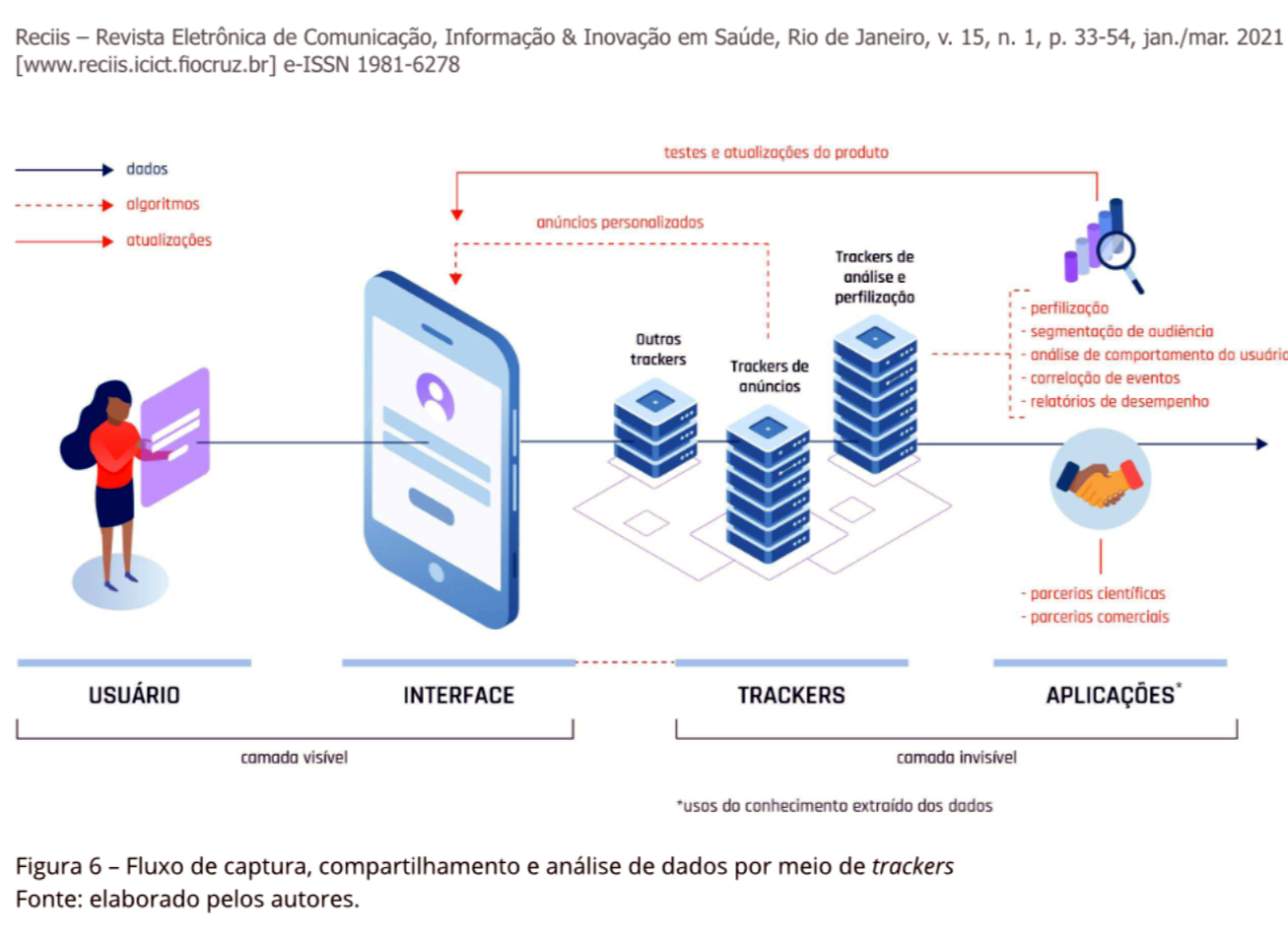

11. Camada visível e camada invisível: coisas em que pouco ou nada pensamos!

Aqui está um esquema muito bem feito. É simples e elucidativo das camadas que um simples uso de um telemóvel (ou de um ecrã) pode acionar. E dá que pensar...

10. O que é “crítica”?

Quem quer assumir um olhar crítico sobre as Humanidades Digitais deve explicitar como entende a noção de “crítica”. Lembremo-nos que o fomento de uma “atitude crítica” têm sido uma competência transversal a quase todas as disciplinas, justamente por ser considerada algo que nos leva para além da dimensão de utilizadores adestrados para a produção e nos desafia a pensar sobre a forma do questionamento, da reflexão sobre os valores epistémicos, o sentido para o mundo social da vida e suas formas culturais.

Assim, pelo meu lado, proponho definir a crítica como um exercício de atenção que visa discernir para poder por em perspetiva e avaliar sem cair em dogmatismos. Nesta proposta de definição, são importantes as palavras “perspetiva” e “avaliar” e “dogmatismos”. A primeira afasta-nos da dimensão funcional e instrumental, permitindo-nos ganhar distância e poder de questionamento; a segunda convoca-nos para uma atribuição de valor dentro de uma ética do provável; a terceira aponta para a incompatibilidade entre a crítica e formulações absolutistas, Diga-se, aliás, que é frequentemente uma das dificuldades de quem critica evitar essa tentação do passe de varinha mágica ontológica que, ao intensificar a sua perspetiva, passa a afirmá-la como sendo “o que é”. Se quisermos recorrer a uma expressão popular, frase recuperada pelo cantautor Vitorino de um seu familiar (o Zé Embirra) para intitular um dos seus discos, poderíamos expressar a atuitude crítica dizendo “Não sei de que se trata, mas não concordo”. O que aliás está em linha com a afirmação de um pensador francês, Émile-Auguste Chartier (pseudónimo, Alain) segundo o qual “Pensar é dizer não”. Também poderíamos dizer: ser crítico é resistir a ser um mero “seguidor”, termo vulgarizado pelas atuais redes sociais.

Rui Alexandre Grácio

9. Que opções estamos a fazer quando nomeamos e aceitamos a designação «inteligência artificial»?

Que opções estamos a fazer quando nomeamos e aceitamos a designação «inteligência artificial»?

Em primeiro lugar, estamos perante uma analogia. Tal como consideramos que, por natureza, o ser humano é inteligente, podemos também considerar que aquilo que tomamos por inteligência pode ser criado pelo/no engenho e construído pelo/no artifício, ou seja, fora do humano, dele exteriorizado, tornado independente do humano na sua corporeidade.

Em segundo lugar, estamos a aceitar como definidora da inteligência um certo tipo de operações. Embora não seja difícil reconhecer que a inteligência é um fenómeno plástico e de múltiplas dimensões, a designação «inteligência artificial» aponta para um único tipo de inteligência e de racionalidade: a racionalidade algorítmica, na qual a inteligência surge estreitamente ligada ao cálculo e à capacidade calculadora. E, mesmo que os seus resultados possam não ser necessários na avaliação que deles façamos, ou se apresentem como probabilísticos e não como certezas, a sua produção interna resulta da necessidade lógica, de um raciocínio lubrificado e exponenciado pela lógica matemática.

Portanto, e para responder à questão inicial, quando utilizamos a expressão «inteligência artificial» estamos, em princípio a aceitar que a inteligência não tem de ser humana, no sentido de estar dependente da corporeidade humana e, por outro lado, estamos a aceitar a redução da inteligência a um tipo muito específico de racionalidade (veiculada por comandos ou código de natureza lógico-matemática). Reitera, a este propósito, Éric Sadin: «(…) é imperativo não conceder a essas lógicas o monopólio da racionalidade, e fazer valer, contra um modo normativo de racionalidade que promete uma suposta perfeição em todas as coisas, modos de racionalidade baseados na aceitação da pluralidade dos seres e na incerteza fundamental da vida. Teremos que viver um conflito de racionalidades na medida em que cada uma delas compromete valores e determina modalidades de existência opostas em todos os pontos. Esta deve ser uma das principais lutas políticas do nosso tempo.» (Sadin, Éric. (2020). La inteligencia artificial o el desafío del siglo. Anatomía de un antihumanismo radical. Buenos Aires: Caja Negra Editora, p. 37).

É claro que podemos ser facilmente seduzidos para esta aceitação através da retórica do deslumbramento e das promessas que geralmente acompanham as grandes façanhas do desenvolvimento tecnológico, com sua promessas e idealizações de um futuro melhor e mais seguro. Por outro lado, não somos capazes de recusar o suposto conforto e utilidade com que os artifícios podem beneficiar a qualidade de vida. Finalmente, há toda uma tentadora pulsão metafísica na ideia de «inteligência artificial», e os valores da segurança, da previsibilidade, da manipulação e do controlo total, seduzem, insensivelmente, muita gente.

No entanto, convém sempre ter em conta que o reconhecimento da inteligência como artificial é um reconhecimento ou uma atribuição humana. Como escreveu Marvin Minsky em 1968, «a inteligência artificial é a ciência de fazer com que as máquinas façam coisas que exigiriam inteligência se fossem feitas por humanos». (Minsky apud Abüeboul, S.; Dowek, G. (2017). Le temps des algorithmes. Éditions Le Pommier, p. 179).

São os humanos que classificam por analogia — e esta figura de retórica é aqui decisiva — um certo tipo de artifício como inteligente e que neles vêem potencialidades sociotécnicas inauditas, seja para o bem ou para o mal.

Rui Alexandre Grácio

8. Desmaterialização ou rematerialização?

«Le mouvement de la « dématérialisation » semble aller de bon train. Il se heurte cependant au fait que numériser ne veut pas dire dématérialiser dans le sens de « priver une chose de tout matérialité ». Si la dématérialisation revient à priver une chose des attributs physiques de son support d’origine, elle consiste en réalité en une re-matérialisation.»

Vinck, D. (2016). Humanités Numériques. La culture face aux nouvelles technologies. Le Chevalier Bleu Éditions. p. 35).

7. O que se perde no processo de quantificação?

«La traduction de quelque chose en nombres ne va jamais de soi ; dans tous les cas, elle revient à négliger quelque chose de l’objet, de la personne ou du phénomène ainsi quantifié. Il convient alors de se souvenir de ce qui est perdu au cours du processus de quantification».

Vinck, D. (2016). Humanités Numériques. La culture face aux nouvelles technologies. Le Chevalier Bleu Éditions. p. 46.

6. Intelecto e inteligência são o mesmo?

O intelecto é «o lado crítico, criativo e contemplativo da mente. Enquanto a inteligência procura compreender, manipular, reordenar, ajustar, o intelecto examina, pondera, questiona, teoriza, critica, imagina. A inteligência irá captar o significado imediato de uma situação e avaliá-la. O intelecto avalia avaliações e procura o significado das situações como um todo… O intelecto [é] uma manifestação única da dignidade humana.»

Hofstadter, 1963, p. 25, apud Berry, D. The computational turn: thinking about the digital humanities. Culture Machine, v. 12, 1-22, 2011, p. 8.

5. O que escreve o ChatGPT sobre a discussão em torno da AI?

A discussão sobre inteligência artificial (IA) envolve uma variedade de argumentos a favor e contra, refletindo as diversas perspectivas éticas, sociais, econômicas e tecnológicas. Aqui estão alguns pontos-chave de ambos os lados:

A Favor da Inteligência Artificial:

Eficiência e Produtividade: Defensores da IA argumentam que ela pode aumentar a eficiência e produtividade em várias áreas, otimizando processos e automatizando tarefas repetitivas.

Inovação Tecnológica: A IA impulsiona a inovação tecnológica, promovendo o desenvolvimento de novas soluções e produtos, especialmente em setores como medicina, automotivo, educação e entretenimento.

Solução de Problemas Complexos: A IA pode ser uma ferramenta valiosa para resolver problemas complexos e enfrentar desafios globais, como mudanças climáticas, doenças e segurança.

Assistência na Tomada de Decisões: Sistemas de IA podem fornecer insights valiosos e auxiliar na tomada de decisões informadas, seja no campo dos negócios, governo ou ciência.

Desenvolvimento Econômico: Muitos acreditam que a IA pode impulsionar o crescimento econômico, criando novas oportunidades de emprego em setores relacionados e estimulando a inovação.

Contra a Inteligência Artificial:

Desemprego e Substituição de Empregos: Um dos principais argumentos contra a IA é o potencial para substituir empregos humanos, levando ao desemprego em larga escala, especialmente em setores tradicionais.

Vieses e Discriminação: Sistemas de IA podem incorporar vieses existentes nos dados de treinamento, resultando em decisões discriminatórias e prejudiciais, especialmente em questões como justiça criminal, contratação e crédito.

Privacidade e Segurança: O uso generalizado da IA pode levantar preocupações sobre a privacidade, especialmente quando se trata de coleta e análise massiva de dados. Além disso, há preocupações sobre a segurança desses sistemas, incluindo o potencial para ataques cibernéticos.

Falta de Transparência: Muitos sistemas de IA, especialmente os baseados em aprendizado profundo, são considerados caixas-pretas, dificultando a compreensão de como eles tomam decisões. A falta de transparência pode aumentar a desconfiança e a apreensão.

Ética e Responsabilidade: A implementação da IA levanta questões éticas, incluindo quem é responsável por decisões erradas ou prejudiciais tomadas por sistemas de IA autônomos, bem como questões relacionadas à segurança e responsabilidade moral.

Em resumo, a discussão em torno da inteligência artificial é complexa e multifacetada, envolvendo considerações éticas, sociais, econômicas e técnicas. O equilíbrio entre os benefícios e os desafios da IA continua sendo um ponto central nas conversas sobre seu desenvolvimento e implementação.

Fonte: ChatGPT, dia 3 de fevereiro de 2024

4. O que podem ser os Digital Studies?

«Ce sont de véritables digital studies qui doivent être entreprises, à l'instar de ce qu'ont pu produire les cultural studies ou les gender studies, qui depuis les années 1970 ne se contentent pas d'étudier certaines normes sociales puissamment à l'œuvre, mais qui simultanément portent leur attention sur les terrains culturels, idéologiques et composites qui les fondent et autorisent leur persistance. Il relève d'une partie de la philosophie, de l'anthropologie, de la sociologie, des sciences économiques, politiques et juridiques, d'examiner les généalogies historiques, les formalisations techniques, leurs intentionnalités plus ou moins décryptables, les intérêts à l'œuvre, les possibles collusions entre des domaines supposés séparés, les jeux de pouvoirs qui s'opèrent, les discours qui se trament et se généralisent, les comportements qui s'instituent. C'est une aventure plurielle de recherche portant sur l' algorithmisation de la vie qui doit être entreprise, ouverte en outre à l'expérimentation de stratégies possibles et désirables.

Dans les faits, c'est une large phénoménologie des structures et des effets qu'il revient à une partie des sciences humaines d'entreprendre, à l'écart de tout savoir computationnel restrictif. Selon Karl Popper, les sciences humaines, parce qu'elles sont incapables d'énoncés prédictifs testables, et donc réfutables, ne relèvent pas de la science, recouvrant une spécificité qui préserverait la liberté humaine, source de vie et de création. On aura compris à travers ce présent ouvrage et ces quelques lignes que c'est à l'intérieur de ces dimensions analytiques et critiques que j'inscris mon entreprise de recherche, qui ne s'envisage que comme une brique à l'intérieur d'un large ensemble divers et exigeant. C'est l'honneur de la mise à distance théorique, de la pensée réflexive, que de ne pas être soumises aux logiques prioritairement fonctionnalistes entretenues par le numérique, de faire en sorte qu'elles puissent défaire les évidences, exposer l'étendue des forces à l'œuvre et offrir des outils d'intelligibilité capables d'inspirer de près ou de loin des gestes individuels et collectifs déployés en toute conscience».

Sadin, E. (2015). La vie algorithmique. Critique de la raison numérique. Éditions de L’Échappée, pp. 244-245.

3. Para onde vais, racionalidade?

«Or, c'est précisément contre cette tentative d'alignement du travail de la raison et de la pensée à la vérité de «chiffres qui parlent d'eux-mêmes» qu'une partie des sciences humaines doit se développer, en vue de s'opposer à ces assauts réductionnistes, d'analyser les conditions de production de tels discours, autant que de celles qui participent sous de multiples formes de l'instauration de modes de rationalité strictement utilitaristes.».

Sadin, E. (2015). La vie algorithmique. Critique de la raison numérique. Éditions de L’Échappée, pp. 240-241.

2. Deixar os dados e os números falarem?

«This is a world where massive amounts of data and applied mathematics replace every other tool that might be brought to bear. Out with every theory of human behavior, from linguistics to sociology. Forget taxonomy, ontology, and psychology. Who knows why people do what they do? The point is they do it, and we can track and measure it with unprecedented fidelity. With enough data, the numbers speak for themselves».

Anderson, Chris (2008). «The End of Theory: The Data Deluge Makes the Scientific Method Obsolete». https://www.wired.com/2008/06/pb-theory/

1. Um novo modelo civilizacional?

«Si «l'âge de l'accès» demeure et ne cesse de s’intensifier, une autre phase, depuis le début des années 2010, se développe en parallèle: «l'ère de la mesure de la vie». La nature du numérique se modifie, jusque-là structurée en vue de principalement assurer la gestion de données pour être maintenant dotée d'une aptitude interprétative et décisionnelle. Mutation massivement en cours, rendue possible par l’extrême sophistication de l'intelligence artificielle qui entraîne un renversement, de la relative maîtrise à observer des informations sur un écran, vers la licence concédée à des systèmes computationnels de suggérer des solutions ou d'engager des actions de façon autonome. Nous passons de fonctionnalités administratives, communicationnelles ou culturelles à une puissance de guidage algorithmique de nos quotidiens et d'organisation automatisée de nos sociétés. La vocation dunumérique franchit un seuil, qui voit ses prérogatives, une extension sans octroyant un pouvoir commune hors-norme mesure de et asymé-trique à ceux qui le façonnent.»

Sadin, Éric (2016). La Silicolonisation du Monde. Éditions de L’Échappée, p. 29).

Última atualização em 23 de fevereiro de 2026